Selon une étude menée par ADP Research en France, 42 % des travailleurs pensent que l’IA pourrait avoir un impact négatif sur leur emploi, tandis que 18 % estiment qu’elle remplacera tout ou partie de leurs fonctions actuelles. Cette angoisse n’est pas une simple inquiétude passagère : elle remodèle profondément la psychologie collective des salariés et transforme les environnements de travail en espaces de tension croissante.

Table des matières

- 1 L’« IA-anxiété » : une peur nouvelle qui gagne du terrain

- 2 Les trois moteurs psychologiques de la peur : ignorance, insécurité et perte de contrôle

- 3 Le paradoxe du stress : gains de productivité et malaise psychologique croissant

- 4 Qui souffre le plus ? Les profils vulnérables à l’automatisation

- 5 La pression du changement permanent : une charge cognitive insoutenable

- 6 Le rôle critique de la communication et de la transparence

- 7 Créer un environnement psychologiquement sûr : au-delà de la formation

- 8 Les stratégies qui fonctionnent : de l’anxiété à l’autonomisation

- 9 Le coût humain du silence : quand l’IA devient toxique

- 10 Vers une IA humaine : repenser la transition

L’« IA-anxiété » : une peur nouvelle qui gagne du terrain

Depuis 2023, une forme d’anxiété spécifique s’est cristallisée dans les organisations : l’« IA-anxiété ». Une étude EY de 2023 montre que 71 % des travailleurs américains se disent préoccupés par l’IA, et que près de la moitié (48 %) sont plus inquiets qu’un an auparavant. Cette montée en puissance n’est pas uniforme. Elle varie selon les secteurs, les âges et les niveaux de qualification.

Clélia Sacadura, psychologue du travail et directrice de l’expertise chez Qualisocial, l’explique sans détour : « L’introduction de l’IA dans le monde du travail peut entraîner un sentiment d’insécurité susceptible d’affecter la santé mentale des employés. Le manque de contrôle sur leur avenir professionnel, couplé à la peur d’être remplacés par des machines, peut générer du stress, de l’anxiété et un sentiment d’impuissance. »

Cette anxiété ne se limite pas à la peur du chômage. Elle englobe la crainte d’être « dépassé » technologiquement, la pression de devoir apprendre constamment et l’incertitude face à des changements organisationnels opaques. Les salariés vivent cette transition comme un compte à rebours vers l’obsolescence, pas comme une évolution naturelle de leur métier.

Les trois moteurs psychologiques de la peur : ignorance, insécurité et perte de contrôle

La peur de l’IA repose sur trois piliers psychologiques distincts. Le premier est le manque de connaissances. Selon une étude citée par ifeel, seuls 17,3 % des travailleurs utilisent actuellement des outils d’IA dans le cadre de leur travail. Cette majorité silencieuse se demande comment ces technologies pourraient transformer son environnement et son avenir professionnel, sans disposer des informations nécessaires pour former une opinion éclairée.

Le deuxième pilier est l’insécurité professionnelle. Un rapport Owl Labs de 2025 montre que plus de la moitié des employés se disent préoccupés pour leur emploi ou leur carrière à cause de l’intégration de l’IA. Les craintes portent sur une baisse de la stabilité de l’emploi et le risque de licenciements (17 %), la nécessité de se requalifier pour rester compétitif (15 %), et la diminution des opportunités de progression (13 %). Une analyse Gallup de 2025 estime qu’environ 6,1 millions de travailleurs américains, en particulier des femmes plus âgées occupant des fonctions administratives ou cléricales, sont particulièrement vulnérables à l’automatisation.

Le troisième pilier est la perte de contrôle perçu. La revue d’El-Helaly et al. (2026) consacrée à l’IA et à la santé mentale au travail insiste sur ce point : l’IA n’est pas neutre psychologiquement. Elle reconfigure la charge mentale, l’incertitude et le contrôle perçu des salariés sur leur environnement. Sans accompagnement, cette recomposition se traduit par un surcroît de stress, même lorsque les gains de productivité sont réels.

Le paradoxe du stress : gains de productivité et malaise psychologique croissant

Voici le paradoxe central : l’IA augmente la productivité tout en dégradant la santé mentale. Une étude mondiale menée auprès de plus de 3 000 professionnels par l’AI Maturity Index et cosignée par l’agence Ballou révèle un fossé psychologique croissant entre les travailleurs qui prospèrent grâce à l’IA et ceux qui se sentent laissés pour compte. Cette nouvelle fracture est davantage liée aux comportements qu’aux caractéristiques démographiques.

Les chiffres parlent d’eux-mêmes : 28 % des travailleurs déclarent un soulagement significatif du stress et un meilleur équilibre vie professionnelle/vie privée grâce à l’IA. Mais 72 % ne constatent aucune diminution de leur stress. Pire encore, 25 % se sentent dépassés et 14 % anxieux concernant leurs capacités liées à l’IA.

En France, un sondage OpinionWay réalisé pour le cabinet Empreinte Humaine en 2025 montre que près d’un salarié sur deux présente un niveau de détresse psychologique modéré ou élevé. Les sources de cette détresse sont multiples : fatigue mentale, charge émotionnelle, perte de sens. Les performances visibles, souvent dopées par l’IA, peuvent masquer l’épuisement intérieur. La productivité mesurée par les indicateurs ne reflète pas forcément la réalité vécue par les salariés, ce qui complique la détection précoce des risques psychosociaux et renforce le sentiment d’isolement.

Qui souffre le plus ? Les profils vulnérables à l’automatisation

La peur de l’IA n’affecte pas tous les travailleurs de la même manière. Les femmes plus âgées occupant des fonctions administratives ou cléricales sont particulièrement exposées. Ces professions offrent moins de « coussin » financier, des compétences moins facilement transférables et une exposition élevée aux tâches routinières. Pour ces travailleurs, l’IA se transforme en source quasi permanente de stress et de peur de déclassement.

Psychologiquement, cette insécurité chronique se traduit par une hyper-vigilance : les salariés scrutent les annonces d’emploi, redoutent chaque changement de logiciel, anticipent des restructurations qui n’ont pas encore été annoncées. L’estime de soi s’érode. Des symptômes de détresse apparaissent : troubles du sommeil, ruminations, anxiété généralisée.

Un facteur clé apparaît néanmoins comme protecteur : l’auto-efficacité liée à l’IA, c’est-à-dire la confiance que l’on a dans sa capacité à apprendre et utiliser ces outils. Plus les salariés se sentent capables de s’approprier l’IA, moins son impact négatif sur leur santé mentale est fort. À l’inverse, ceux qui se vivent comme « en retard » ou « techniquement faibles » sont plus exposés à l’angoisse, au retrait, voire à des trajectoires de désengagement silencieux.

La pression du changement permanent : une charge cognitive insoutenable

Au-delà de la peur du remplacement, l’IA génère une pression diffuse : le sentiment de devoir suivre en permanence le rythme technologique. Les salariés craignent d’être « largués » face à des collègues plus à l’aise avec l’IA. L’injonction à produire toujours plus vite grâce aux nouveaux outils pèse sur les épaules. Cette dynamique alimente une surcharge cognitive où l’attention se fragmente entre le cœur du métier, la maîtrise des outils et la gestion de l’infobésité.

La charge mentale s’accroît. Les salariés doivent non seulement faire leur travail, mais aussi apprendre de nouveaux outils, adapter leurs processus, rester informés des évolutions technologiques. Cet apprentissage permanent n’est pas un luxe : c’est devenu une condition de survie professionnelle. Pour ceux qui n’ont pas grandi avec la technologie, cette transition est vécue comme un défi insurmontable.

Adopter l’intelligence artificielle signifie changer sa façon de travailler, de prendre des décisions, d’interagir avec ses collègues et ses outils. Cela signifie accepter que certaines tâches puissent être automatisées, que de nouvelles compétences deviennent nécessaires, que le rôle de chacun évolue. Et cela génère naturellement de l’anxiété, même chez les salariés les plus motivés.

Le rôle critique de la communication et de la transparence

Voici un point que les organisations sous-estiment gravement : l’impact de l’IA sur la santé mentale dépend moins de la technologie elle-même que de la manière dont elle est communiquée et déployée. Les données PwC de 2025 montrent que, malgré les inquiétudes, l’optimisme quant au potentiel de l’IA dépasse globalement l’anxiété. Mais cet optimisme est étroitement dépendant du climat de confiance, de la culture d’entreprise et de la clarté des changements annoncés.

Lorsque la communication est floue, que les salariés ne sont pas impliqués dans les décisions de déploiement, ou que les critères d’utilisation de l’IA restent opaques, la même technologie peut devenir une source de stress, de désengagement et de burnout. Les rumeurs prolifèrent dans les vides informationnels. Les salariés imaginent le pire, car personne ne leur dit la vérité.

À l’inverse, les organisations qui communiquent ouvertement sur les plans de déploiement, qui impliquent les employés dans les décisions et qui explicitent les critères d’utilisation créent un environnement psychologiquement plus sûr. Cette transparence ne supprime pas l’anxiété, mais elle la rend gérable. Elle transforme la peur de l’inconnu en inquiétude face au connu, ce qui est psychologiquement moins destructeur.

Créer un environnement psychologiquement sûr : au-delà de la formation

Pour surmonter la résistance à l’IA, il faut bien plus qu’une campagne d’information ou quelques heures de formation. Il faut créer un environnement psychologiquement sûr, dans lequel les gens se sentent autorisés à poser des questions, à exprimer leurs doutes, à expérimenter sans crainte de se tromper.

Cet environnement repose sur plusieurs piliers. Le premier est l’éducation ciblée. Il faut fournir des informations claires et transparentes sur la manière dont l’IA affectera les rôles et les responsabilités. Cela réduit l’incertitude et prépare les employés aux changements à venir. Le deuxième pilier est l’implication des employés. Inclure les employés dans les discussions sur l’adoption de la technologie, en leur permettant d’apporter des idées et de donner leur avis, accroît leur sentiment d’appropriation et enrichit le processus de mise en œuvre.

Le troisième pilier est le développement des compétences. Avec les progrès technologiques, la demande de nouvelles compétences est inévitable. Les organisations doivent transmettre des compétences techniques et promouvoir la résolution de problèmes. Il faut favoriser un état d’esprit d’apprentissage continu pour que les salariés restent flexibles et ouverts à de nouvelles méthodes de travail. Cela réduit la résistance au changement et favorise l’épanouissement personnel et professionnel.

Les stratégies qui fonctionnent : de l’anxiété à l’autonomisation

Transformer la peur en opportunité de croissance n’est pas une utopie managériale. C’est un processus qui repose sur des actions concrètes et mesurables.

La première stratégie est l’information et l’éducation. Fournir des ressources éducatives spécifiques aide les employés à comprendre les changements technologiques et à s’y adapter. Les organisations qui investissent dans des programmes de formation adaptés voient une réduction significative de l’anxiété liée à l’IA. Cette formation ne doit pas être générique : elle doit être adaptée aux métiers, aux niveaux de compétence et aux besoins spécifiques de chaque département.

La deuxième stratégie est l’implication et la participation. Inclure les salariés dans les décisions de déploiement crée un sentiment d’appropriation. Ils ne sont plus des récepteurs passifs d’une technologie imposée d’en haut. Ils deviennent des acteurs de la transformation. Cette participation réduit la résistance et augmente l’adoption réelle de l’IA.

La troisième stratégie est la création d’une culture d’apprentissage continu. Les organisations qui valorisent l’apprentissage et l’expérimentation produisent des salariés plus résilients face aux changements technologiques. Ces salariés voient l’IA comme une opportunité d’augmentation de leurs capacités, pas comme une menace pour leur emploi.

La quatrième stratégie est la promotion de la résilience organisationnelle. Cela signifie créer un environnement dans lequel la santé mentale est une priorité. Cela signifie aussi reconnaître que certains salariés souffrent plus que d’autres et leur offrir un soutien adapté. Promouvoir un environnement de soutien et de collaboration renforce l’engagement et améliore la capacité d’adaptation de l’organisation face aux changements technologiques.

Le coût humain du silence : quand l’IA devient toxique

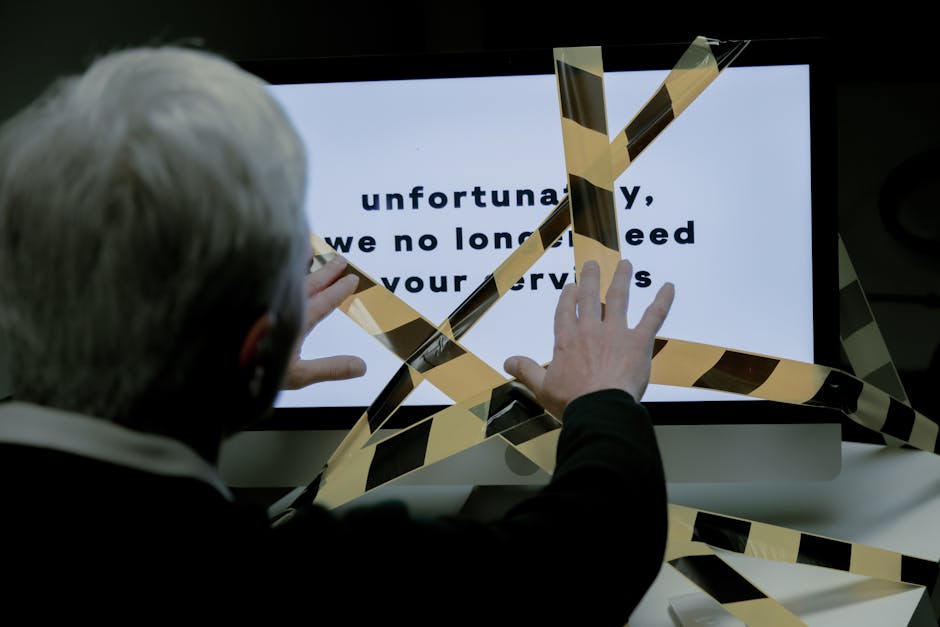

Il existe une réalité que les organisations préfèrent ignorer : l’IA peut devenir toxique quand elle est déployée sans considération pour la santé mentale des salariés. Cette toxicité se manifeste par des symptômes silencieux mais destructeurs : désengagement, turnover accru, burnout, dépression.

Le silence des organisations sur les impacts réels de l’IA aggrave cette toxicité. Les salariés ne savent pas si leurs craintes sont justifiées ou paranoïaques. Ils ne savent pas si leur métier sera automatisé dans six mois ou dans dix ans. Ils vivent dans l’incertitude permanente. Cette incertitude chronique est plus destructrice que la certitude, même négative. Un salarié qui sait qu’il sera licencié peut agir : chercher un nouveau travail, se former. Un salarié qui ne sait pas s’il sera licencié reste paralysé.

Les organisations qui ignorent cet impact risquent une hémorragie de talents. Les meilleurs salariés, ceux qui ont des options, quittent les entreprises où l’IA est imposée sans transparence. Restent ceux qui n’ont pas d’autre choix, ceux qui sont les plus vulnérables. C’est un cercle vicieux : l’organisation perd ses talents les plus adaptables et conserve ses salariés les plus rigides.

Vers une IA humaine : repenser la transition

La transition vers une IA intégrée n’est pas une fatalité technologique. C’est un choix organisationnel. Les entreprises qui réussissent cette transition ne sont pas celles qui imposent l’IA de manière top-down. Ce sont celles qui créent un dialogue authentique avec leurs salariés, qui reconnaissent leurs craintes comme légitimes, qui investissent dans leur développement et leur bien-être.

Cette approche humaniste de l’IA n’est pas une dépense : c’est un investissement. Les organisations qui soutiennent activement leurs salariés pendant cette transition voient une adoption plus rapide de l’IA, une productivité plus stable et une culture d’entreprise plus forte. Les salariés qui se sentent soutenus deviennent des champions de la transformation, pas des obstacles.

La question n’est pas : « Comment imposer l’IA malgré la peur des salariés ? » La question est : « Comment créer une transition vers l’IA qui respecte la santé mentale et les aspirations professionnelles de nos salariés ? » Cette question change tout. Elle place la psychologie humaine au cœur de la stratégie technologique, pas en marge.

En 2026, les organisations qui comprendront cette vérité auront un avantage compétitif décisif : une main-d’œuvre engagée, résiliente et capable de s’adapter aux changements futurs. Celles qui ignoreront cette réalité verront leur performance technologique minée par des problèmes psychologiques et organisationnels qu’elles auront elles-mêmes créés.

.acgp-sources-accordion {

margin: 2em 0;

border: 1px solid #e0e0e0;

border-radius: 8px;

background: #fafafa;

}

.acgp-sources-details {

margin: 0;

}

.acgp-sources-summary {

display: flex;

align-items: center;

gap: 0.5em;

padding: 1em 1.5em;

cursor: pointer;

font-weight: 600;

font-size: 1.1em;

color: #333;

list-style: none;

user-select: none;

}

.acgp-sources-summary::-webkit-details-marker {

display: none;

}

.acgp-sources-chevron {

margin-left: auto;

transition: transform 0.3s ease;

font-size: 0.8em;

}

.acgp-sources-details[open] .acgp-sources-chevron {

transform: rotate(180deg);

}

.acgp-sources-content {

padding: 0 1.5em 1.5em;

}

.acgp-sources-list {

margin: 0;

padding: 0;

list-style: none;

}

.acgp-sources-list li {

padding: 0.5em 0;

border-bottom: 1px solid #eee;

font-size: 0.95em;

line-height: 1.5;

}

.acgp-sources-list li:last-child {

border-bottom: none;

}

.acgp-source-num {

color: #666;

font-weight: 600;

margin-right: 0.3em;

}

.acgp-sources-list a {

color: #1a73e8;

text-decoration: none;

}

.acgp-sources-list a:hover {

text-decoration: underline;

}

.acgp-source-domain {

color: #999;

font-size: 0.85em;

}

Sources et références (14)

▼

- [1] Qualisocial (qualisocial.com)

- [2] Affectus.media (affectus.media)

- [3] Ifeelonline (ifeelonline.com)

- [4] Gpomag (gpomag.fr)

- [5] Logotel (logotel.fr)

- [6] Francetravail (francetravail.org)

- [7] Revuegestion.ca (revuegestion.ca)

- [8] Nocodetoulouse (nocodetoulouse.fr)

- [9] Cerveauetpsycho (cerveauetpsycho.fr)

- [10] Formation.kpmg (formation.kpmg.fr)

- [11] Eudonia (eudonia.fr)

- [12] Savoiria (savoiria.fr)

- [13] Intefp.travail-emploi.gouv (intefp.travail-emploi.gouv.fr)

- [14] Sigma-rh (sigma-rh.com)

{

« @context »: « https://schema.org »,

« @type »: « Article »,

« headline »: « La peur de l’IA au travail : psychologie de la transition technologique en milieu professionnel »,

« author »: {

« @type »: « Person »,

« name »: « Ecoute-psy.com »

},

« datePublished »: « 2026-04-18T15:59:14+00:00 »,

« dateModified »: « 2026-04-18T15:59:14+00:00 »,

« citation »: [

{

« @type »: « CreativeWork »,

« name »: « Qualisocial »,

« url »: « https://www.qualisocial.com/blog/sante-mentale-ia »

},

{

« @type »: « CreativeWork »,

« name »: « Affectus.media »,

« url »: « https://affectus.media/limpact-de-lia-sur-la-sante-mentale-au-travail-en-2026/ »

},

{

« @type »: « CreativeWork »,

« name »: « Ifeelonline »,

« url »: « https://ifeelonline.com/fr/dissiper-la-peur-de-l-ia-au-travail/ »

},

{

« @type »: « CreativeWork »,

« name »: « Gpomag »,

« url »: « https://www.gpomag.fr/leurope-face-au-paradoxe-du-stress-lie-a-lia-gains-de-productivite-importants-et-soulagement-mental-inegal/ »

},

{

« @type »: « CreativeWork »,

« name »: « Logotel »,

« url »: « https://www.logotel.fr/magazine/resistance-ou-confiance-envers-lia-comment-passer-de-langoisse-technologique-a-lautonomisation/ »

},

{

« @type »: « CreativeWork »,

« name »: « Francetravail »,

« url »: « https://www.francetravail.org/accueil/actualites/2025/sante-mentale-au-travail-l-ia-passe-en-mode-prevention.html?type=article »

},

{

« @type »: « CreativeWork »,

« name »: « Revuegestion.ca »,

« url »: « https://www.revuegestion.ca/lintelligence-artificielle-nuirait-elle-au-bien-etre-des-employes »

},

{

« @type »: « CreativeWork »,

« name »: « Nocodetoulouse »,

« url »: « https://nocodetoulouse.fr/ia-sante-au-travail/ »

},

{

« @type »: « CreativeWork »,

« name »: « Cerveauetpsycho »,

« url »: « https://www.cerveauetpsycho.fr/sd/intelligence-artificielle/l-ia-anxiete-la-nouvelle-peur-des-machines-25891.php »

},

{

« @type »: « CreativeWork »,

« name »: « Formation.kpmg »,

« url »: « https://formation.kpmg.fr/leclaireur/article/l-impact-de-l-ia-sur-les-competences-et-la-transformation-des-metiers »

},

{

« @type »: « CreativeWork »,

« name »: « Eudonia »,

« url »: « https://eudonia.fr/dependance-a-lia-7-verites-choc-pour-reprendre-le-controle-face-aux-algorithmes/ »

},

{

« @type »: « CreativeWork »,

« name »: « Savoiria »,

« url »: « https://www.savoiria.fr/formation-ia-entreprise-france-2026/ »

},

{

« @type »: « CreativeWork »,

« name »: « Intefp.travail-emploi.gouv »,

« url »: « http://www.intefp.travail-emploi.gouv.fr/fr/node/1638 »

},

{

« @type »: « CreativeWork »,

« name »: « Sigma-rh »,

« url »: « https://www.sigma-rh.com/fr-fr/blog/les-tendances-rh-a-surveiller-cette-annee/ »

}

]

}